你的產品,具備「與AI交易」的能力嗎?

當 AI 大幅提升了營運效率,為什麼在 B2B 支付裡反而形成一種困境?

我們在前兩篇文章,已經分別談過兩件事:

這一篇,是這個三部曲的最後一章。

如果前兩篇是在回答「加密支付為什麼先從 B2B 開始」,那這一篇,其實是在回答另一個更有挑戰性的問題:當執行者不再是人類,我們的金融制度還撐得住嗎?

.

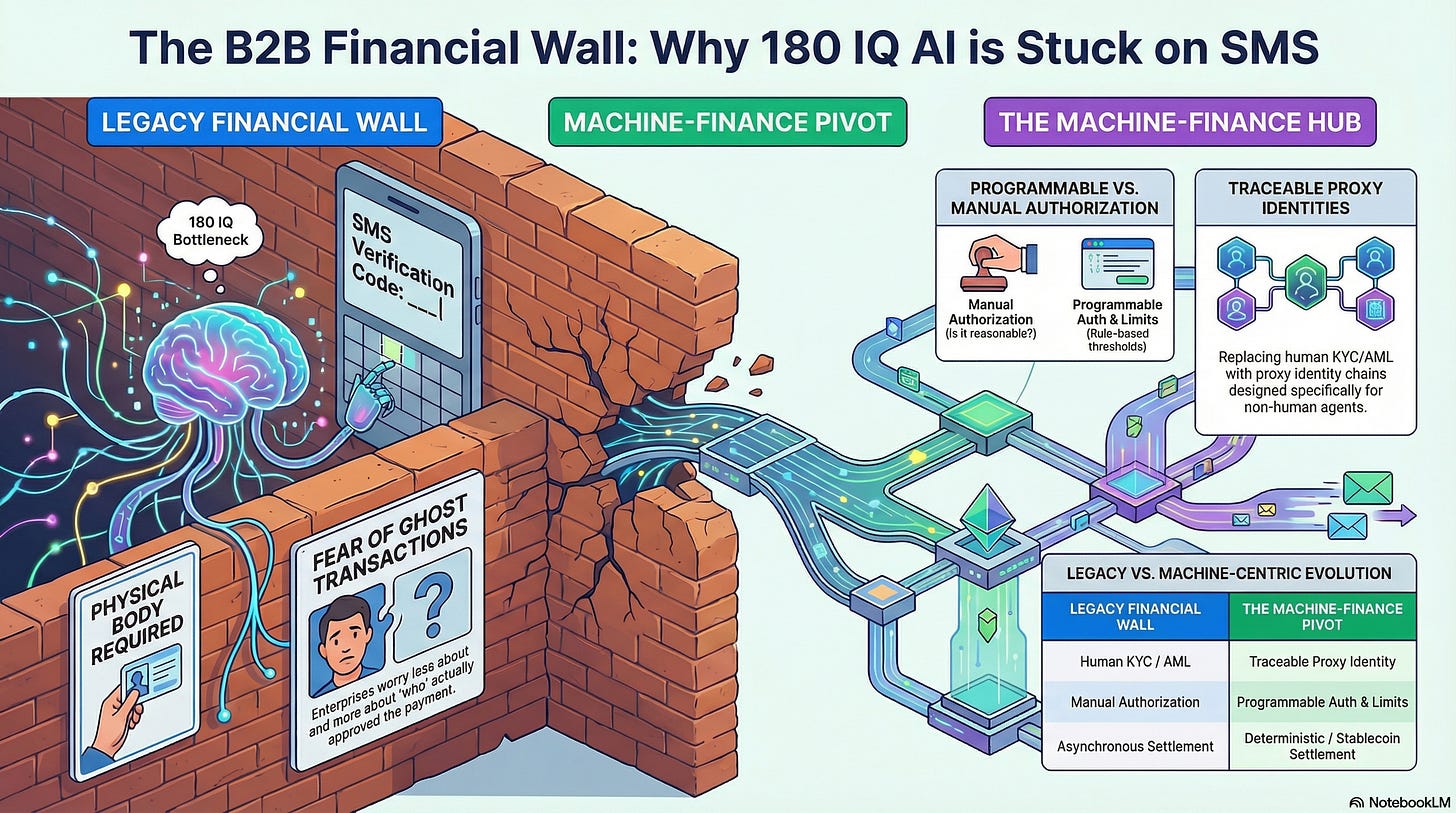

一個荒謬的現實:智商 180 的員工,卡在簡訊的識別碼

想像一個看似再合理不過的場景:

你公司裡有一個「數位員工」一個 AI Agent,負責比價、下單、續約 SaaS、支付雲端費用,它能做出比人類更快、更理性的決策,也完全遵守你事先設定的預算與規則。

但當它準備付款時,流程卻卡住了。

不是因為餘額不足,而是系統要求「請輸入簡訊驗證碼」、「請上傳身分證」、「請人工確認」,問題不在於 AI 不夠聰明,而在於我們的金融系統,根本不是為「非人類」準備的。

這就是當前科技世界最大的諷刺:我們擁有能模擬人類思考的 AI,卻強迫 AI 必須具備「肉體」才能開戶;AI 的效率越高,這道牆就顯得越厚。

我們必須理解在企業裡,

最讓人不安的從來不是「慢」,

而是「這筆錢,到底算不算我批准的?」.

為什麼 B2B 支付會是海景第一排?

在 B2C 世界,支付追求的是體驗、成功率、即刻完成交易,Agent 訂錯一張機票,頂多是個人損失風險可控。

而 B2B 支付必須滿足責任與治理,AI Agent 若誤付了 100 萬美金的貨款,涉及的是合規、審計、甚至公司破產。

當然,這世界永遠不缺乏聰明人,我們也不會是第一個看見問題的人

如果只是效率問題,銀行早就優化了。

如果只是技術問題,工程師也早就解了。

那為什麼十幾年過去,支付流程反而越來越嚴?

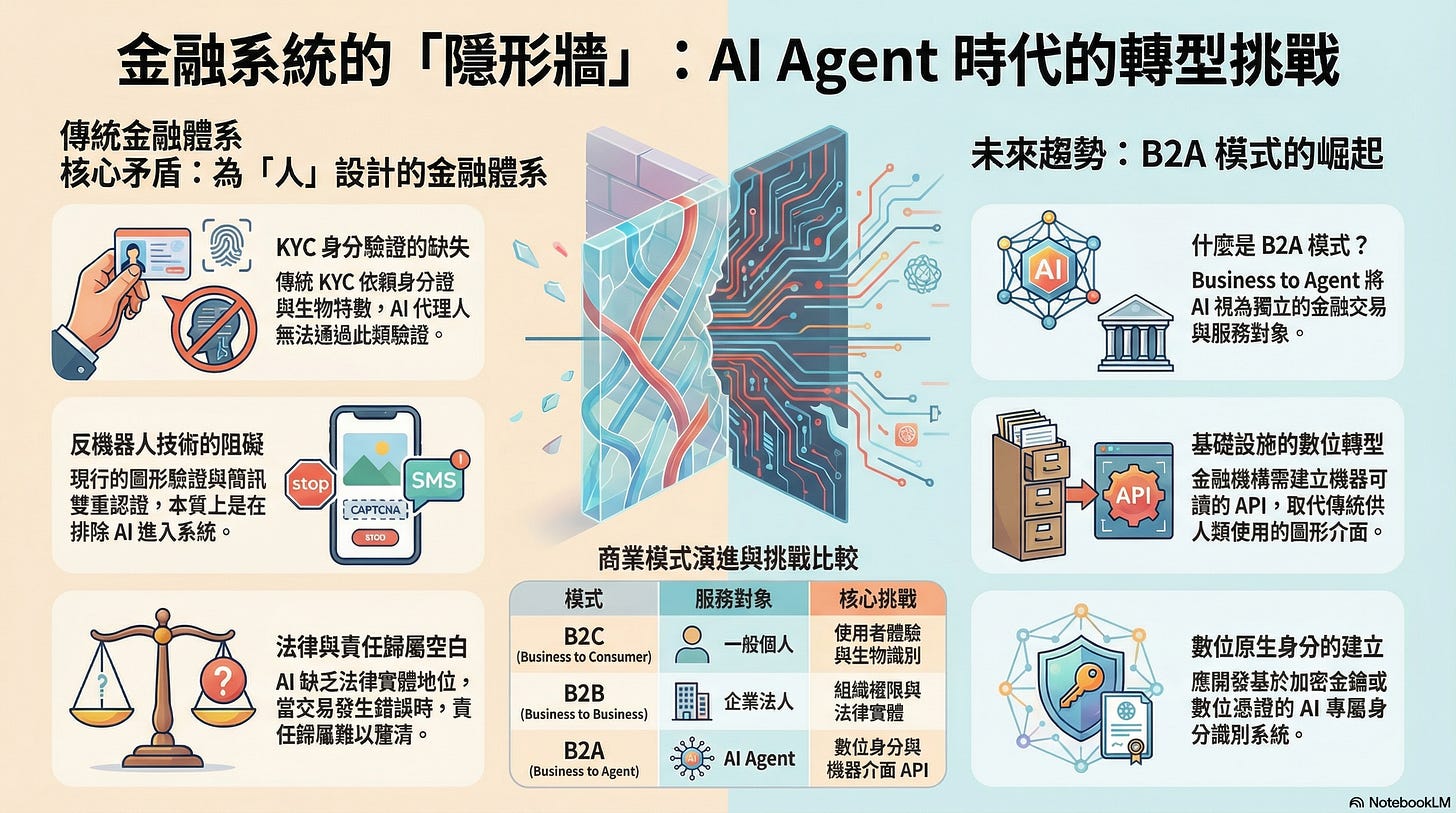

這是因為,現有的 B2B 金融制度有幾個不可撼動的前提:

付款者權限歸屬: 必須能追溯到某個具體的「人」或「法人代表」

審計軌跡: 每一筆交易都必須符合公司治理 Corporate Governance 的預設規則,如每一筆錢,都要能追溯到「誰批准的」

錯誤與詐欺:時間與人力成本極高,寧願慢,也不接受模糊

這套設計,在沒有人類年代,其實是合理的,但同時這三點,在「非人」的 AI agent 使用者面前全盤失效

AI Agent 本質上,既不是自然人,也不是法人。

對 CFO 來說,AI 最大的風險不是它不夠聰明,而是它無法被歸責,於是,我們只能把 AI 當成「建議者」,讓人坐在電腦前點擊最後一關,這種「人為介入」保住了責任,卻扼殺了 AI 的 100 倍增長效益。

.

B2B 金融支付牆,含括了四層責任設計

要理解這問題,我們的先嘗試拆解當前的責任機制,找出合適的嵌入可行性。

(1) 授權牆:B2B 的”同意”不是按鈕,而是責任背書

在 B2B 世界裡,付款同意不是 UX 行為,而是治理行為。

誰有權限?

權限上限是多少?

超過門檻要不要二次確認?

是否符合內控與審計?

OTP、雙簽、人工審核,表面看是效率問題,本質上是誰願意為這筆錢背書?而 AI Agent 無法「背書」,只能「執行」。

所以對AI來說,關鍵問題不是能不能付錢,

而是「誰敢讓它付錢」

在 B2B 世界裡,付款不是一個 UX 動作,而是一種責任背書。

當系統無法判斷「這行為是否代表某人或某個角色的同意」,

它唯一安全的選擇,就是把決策權收回人類手上。.

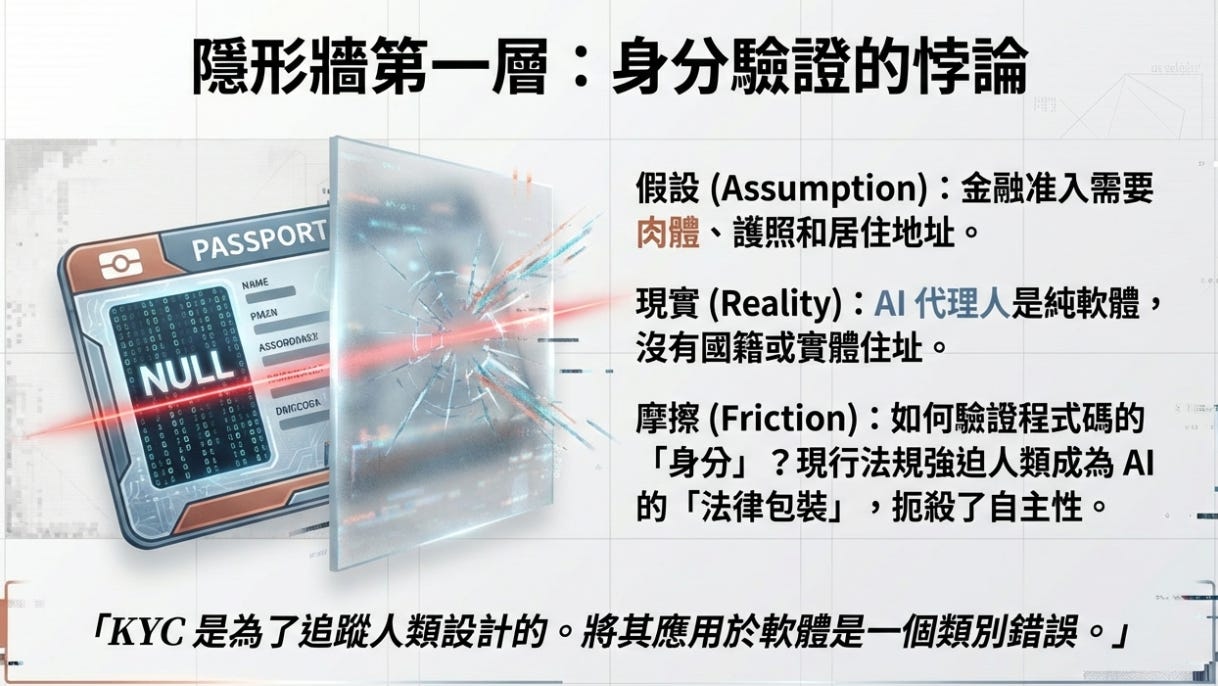

(2) 合規牆:KYC / AML 是為「人與法人」設計的

當我們談到 KYC / AML 時,很容易把它理解成「監管保守」或「制度落後」,但從金融系統的角度來看,問題其實更單純——

現行的合規制度,從來不知道該如何「辨識一個不是自然人的行為者」。

KYC 的設計前提,是每一筆資金行為,最終都能回溯到一個人或一個法人代表;這個對象可以被拍照、被簽名、被凍結帳戶,甚至被起訴。

但 AI Agent 不是人,也不是公司,它是一個被授權執行任務的系統角色,卻沒有任何制度上的「法律人格」。

當執行者消失,制度能做的唯一選擇,就是拒絕讓行為發生。

合規並不是反對 AI,而是目前的合規制度,

不知道該如何「合規一個不是自然人的行為者」。

KYC與AML的設計前提,

是資金行為最終可回溯到某人或某法人。

但當執行者變成Agent,制度就失去了它的錨點——

一個可以被拍照、簽名、甚至被起訴的對象。.

(3) 結算牆:延遲與可撤銷,是企業世界的保險機制

我們勢必不能只考量 happy case 正常的完成付款,因此 B2B 付款的業務勢必牽涉到以下關鍵步驟:

延遲結算

對帳、發票、稅務

退款或沖帳

這些設計是為了保護企業,並與現有制度整合,但對 AI 驅動的流程而言,它們會製造大量狀態不確定性,例如 Agent 需要額外去理解:「這筆錢看起來付了,但其實還沒真的算數。」

這些延遲與可撤銷的設計,對人類來說是保護機制,

對AI來說卻是流程不確定性。

人類可接受「這筆錢看起來付了,但還不算真的完成」,

但對自動化系統而言,

這種狀態模糊,會直接破壞後續的執行邏輯。

當付款不再是確定事件,而是待確認狀態,

AI的效率反而變成風險來源。.

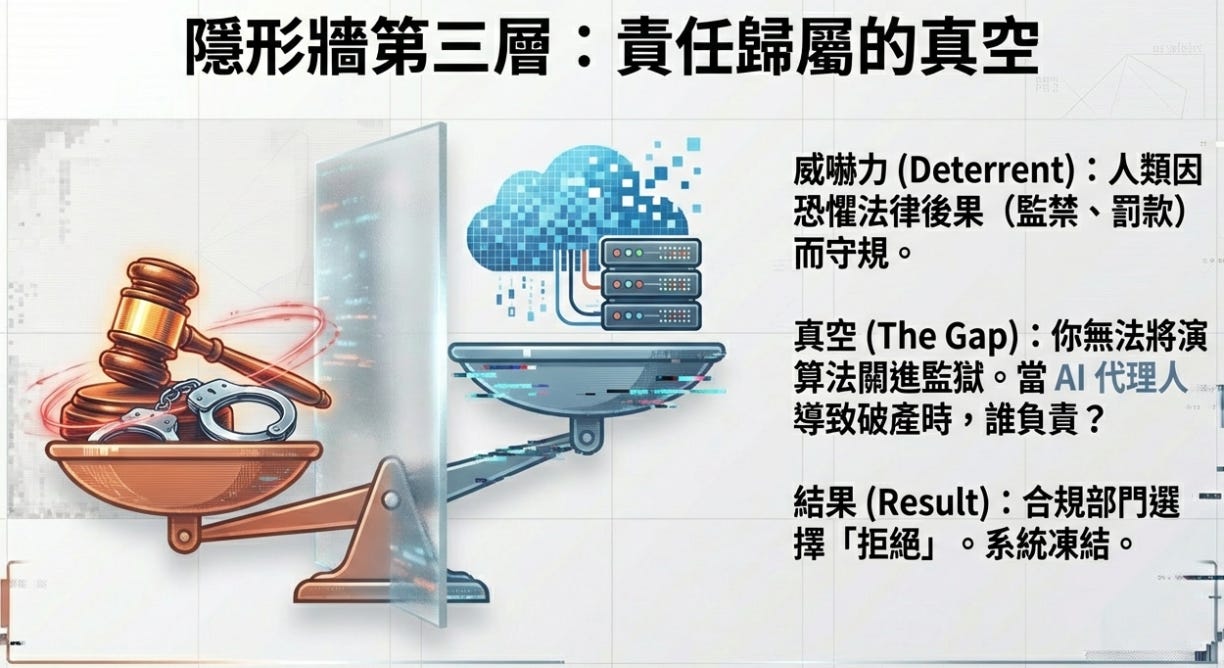

(4) 責任牆:金融系統真正關心的是「出事找誰」

在所有金融設計裡,最被低估、卻最關鍵的一件事,絕對是:出事的時候,要找誰。

人類金融系統之所以能運作,不是因為流程多順,而是因為每一個環節,都能指向一個「可以被究責的主體」。

AI 幫你選錯供應商,誰負責?

AI 幫你在制裁邊緣付款,誰扛?

AI 自動化付款造成資金風險,算不算內控失職?

AI Agent 可以做決策、可以執行流程,但它無法被懲戒、無法被起訴,也無法承擔法律後果;所以當 AI 取得越高的執行效率,在現行制度下,它反而被視為一個更大的風險來源。

這不是技術落後,而是責任設計還沒跟上。

如果我們回答不了這些問題,決策者 or 財務系統一定會選擇「不要讓 AI 付錢」。

.

回頭看這四道金融牆,你會發現它們並不是阻礙創新,而是過去幾十年來,金融系統為了保護人類而累積的安全結構。那問題就在於,當執行者開始不是人類時,這些原本合理的設計,反而一起變成了 AI 無法跨越的制度門檻。

這裡有一個非常反直覺、但對產品團隊極重要的結論:

AI 把決策速度放大 10 倍,

任何「需要人類介入」的制度設計,都會被放大成 10 倍的成本。

所以我們看到的不是 AI 推不動 B2B 支付,而是金融制度,將被 AI 強迫適應新時代。

.

如果不靠加密技術,難道沒有其他方法了嗎?

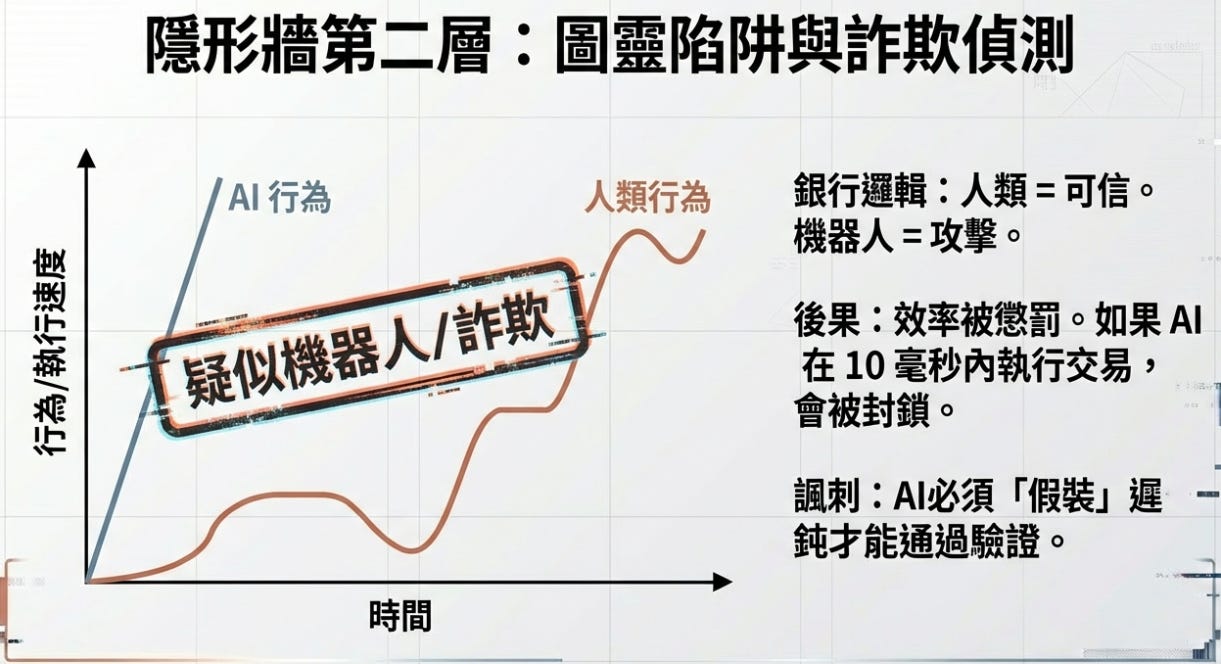

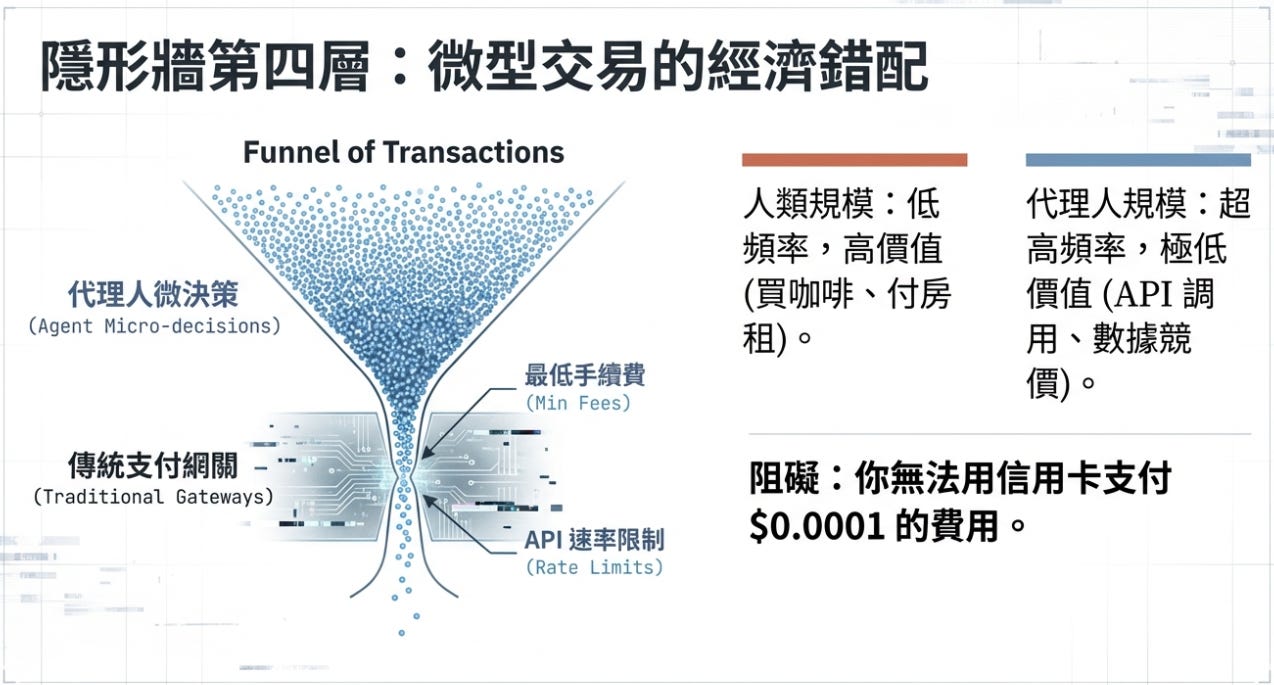

作為讀者,我們一定會質疑:「既然只是 OTP 或白名單的問題,在當前流程裡微調一下不就解決了?例如標記 Agent 帳號、預設白名單,為什麼一定要用區塊鏈或一個新的支付協議 x402?」

這就是最關鍵的辯證點,即使採用漸進式優化,但在 AI 時代仍會遇到三個 blocker:

「許可制」的擴展瓶頸:

目前的方案是 ”銀行許可我,我再許可 Agent”,這需要極高的人工對齊成本

更進一步,我們將場景擴大到 AI 能彼此交流,當未來市場上有千萬個 Agent 彼此交易時,逐層許可的人工對齊成本,將徹底抵銷 AI 帶來的邊際成本下降

「責任黑盒」的法律真空:

類比自駕車肇事:責任在軟體商還是駕駛?我們必須承認當前的法律與金融系統尚無法處理「非人實體」的違約

在當前體制框架下,若 AI 誤付一筆大額款項,現有的結算機制會因無法判定「主觀意圖」而陷入癱瘓

「延遲結算」的信任成本:

傳統支付是 T+N 以天為單位的結算週期

然而 AI 之間需要的是毫秒級的原子化結算(Atomic Settlement),在當前金融系統中,這種高頻結算會產生巨大的流水對帳壓力,最終導致系統/人力崩潰

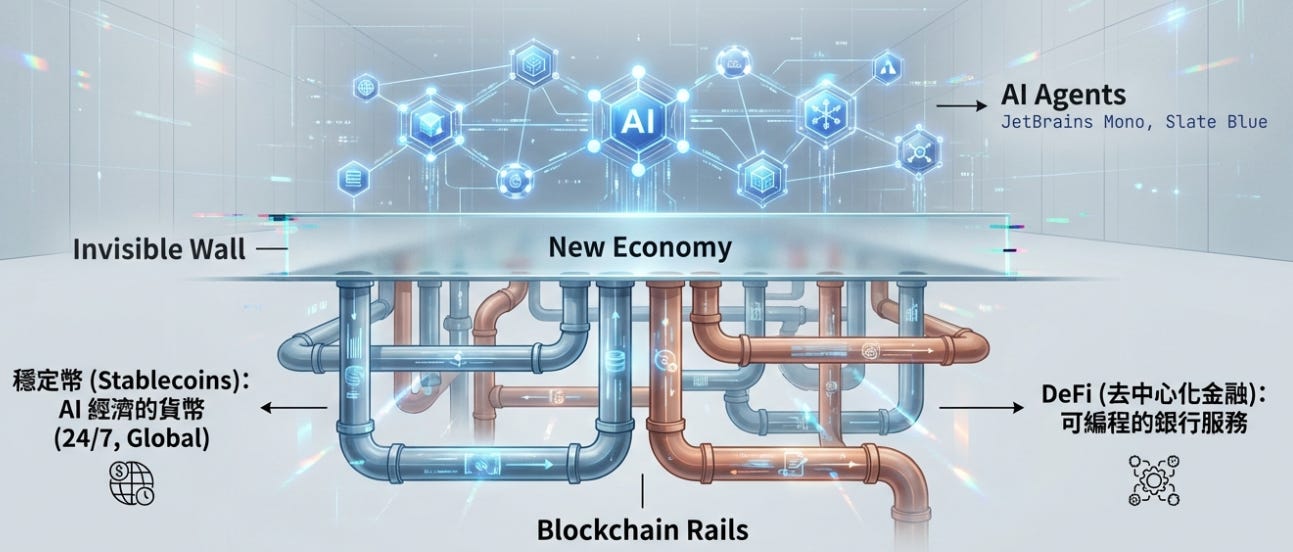

結論是:Web2 是在「為人設計的流程」中開後門,而加密技術(x402/AA)是直接為程式碼重蓋一座地基。

.

「產品之外」每週分享 Crypto、Fintech 與科技趨勢,結合商業策略與實戰邏輯,深度分析產業新知,若對您有所啟發、請不吝訂閱並分享!

.

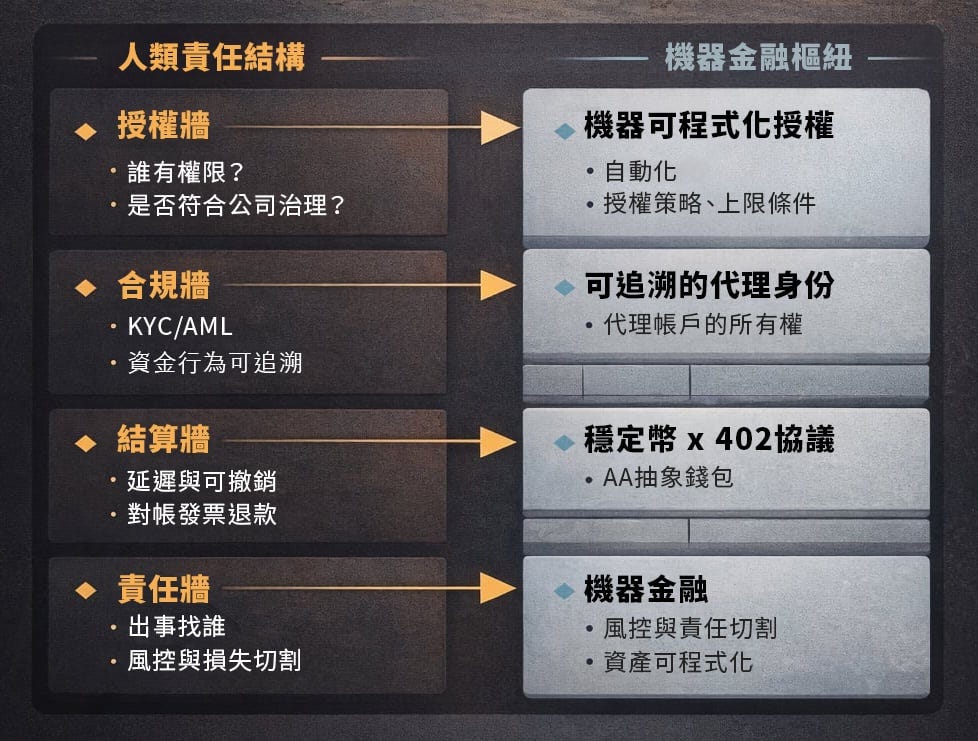

解法定位:「AI 原生金融」不只是加密貨幣,而是制度進化

這也是為什麼當前市場大力度的強調 AA (Account Abstraction) 與 x402 協議 的原因,我們看到的這些協議與嘗試,不是因為 crypto 想要取代金融,而是因為現有金融結構,開始承受不了「非人類行為密度」

是為了讓金融系統從「生物識別」轉向「邏輯識別」,我們進一步須考量 B2A的關鍵技術:

授權牆:從「人點按鈕」轉向「可程式化授權」

合規牆:從「身分證 KYC」轉向「加密身分 Delegated Identity」

結算牆:從「不確定的延遲」轉向「確定的即時結算」

責任牆:從「事後找人算帳」轉向「事中程式碼隔離」

這包含了三個型態的轉變:

從「身分證明」到「代理關係」,金融系統不需要知道這個 Agent 是誰、或是它背後的使用者的 KYC 資料,只需要知道「代理關係」,例如

它代表哪個公司?

權限是誰給的?

可否被撤銷?

出事能不能一路追到最終責任人?

透過 x402 協議,讓 AI 可以擁有一個智能合約錢包,它的身分證不是照片,而是密碼學簽名,將 Agent 與人解偶,使用「代理」的身份,而不是繼續用 KYC 生物識別身份

從「事後究責」到「事中風控」,與其等 AI 犯錯後去告它,不如把公司政策直接寫進資產裡,把人類介入的同意關卡,變成可程式化執行的政策,也就是資產的可程式化特性,例如:

每日 / 每月上限

僅限特定供應商

僅限特定幣別 / 國家

超過條件自動暫停並升級人工審批

這將不只是 UX,而是公司治理的自動化。

從「責任模糊」到「責任區隔」,B2B 世界不怕風險,怕的是責任模糊,未來能讓 AI Agent 真正進入支付的關鍵,不是完全免責,而是:

哪些風險由系統承擔

哪些風險由企業承擔

哪些情境必須人工介入

這是一個制度產品問題,不是一個協議問題。

AI 終於不需要去「假裝自己像人」,而是使用密碼學簽名作為身分證,讓「Agent to Agent」的交易可以在無須人工介入的情況下,達到 100% 的信任度。

.

小結:我們的產品,具備跟 AI 交易的能力嗎?

在支付與金融產品第一線待久了,你會慢慢發現,真正限制創新的,從來不是工程能力,而是我們願不願意重新定義「誰可以被信任」

文章最後要反問所有讀者,尤其是產品負責人與經營者:你的支付基礎設施,是在保護公司,還是在阻礙未來?

如果系統依然高度依賴人工介入與生物識別,就是在將未來最大的非人使用者市場推向門外。滿足與 AI 交易的能力,不再是選項,而是生存條件:

授權規則化:從 UI 點擊轉向 API 與智能合約

結算原子化:支持即時清算,不再有清算時間差

責任預設化:將風控寫入資產本身,而非依賴事後律師

AI 在金融領域的發展瓶頸,可能不只是算力,而是我們這套運作了幾百年的老舊金融制度,當 AI 已經能思考,資產就必須能程式化。

.

最後,我們回頭看加密支付的三篇文章,脈絡其實很清楚

當 AI 出現,責任結構開始全面吃緊(本文)

這不是在預測未來,而是在描述一個已經開始發生的現實,如果我們正在做 B2B 產品、支付、平台或企業內控,真正該問的問題,可能不是:「我們要不要用 AI?」

而是:「我們的金融與責任設計,準備好讓『不是人』參與了嗎?」

.

文末附上小額贊助連結,支持我持續產出獨立且有深度的文章。

歡迎透過下方連結請我喝杯咖啡,也期待讓我知道你的成長心得與閱讀回饋。

.

參考資料:

Cloudflare與Coinbase宣布合作推動 x402 Foundation,定位成一種開放網路支付標準/AI 驅動支付標準

Google在雲端端推出 Agent Payments Protocol(AP2),並提到 x402 作為 agent-based crypto payments 的一種延伸/組件

Stripe推出 Agentic Commerce Suite 與相關指南/標準討論,核心聚焦「讓商家變得 agent-ready」與信任/確認/風控等問題

Stripe 在討論 agentic commerce 的開放標準時,也把「信任、確認購買、風險訊號」放在核心

Perplexity 的 agentic shopping 工具還引發與 Amazon 的法律衝突(涉及自動化行為、帳號存取與平台規範)

Perplexity 在美國推出「Buy with Pro」這類一站式 AI 購物體驗,本質就是在縮短從「對話」到「購買」的距離